Logistic Regression

$$\hat{y} = \sigma(w^T x + b)$$

$w^T x + b$ : 선형 변환

$\sigma(\cdot)$: 출력에서만 적용하는 비선형 함수 (sigmoid)

❗ 중간에 hidden layer 없이 바로 출력층에 sigmoid만 존재

Logistic regression은 결정 경계가 선형이고,

단지 출력값을 "확률값으로 해석하기 위해 sigmoid를 사용"했기 때문에

"선형 모델"로 분류됩니다.

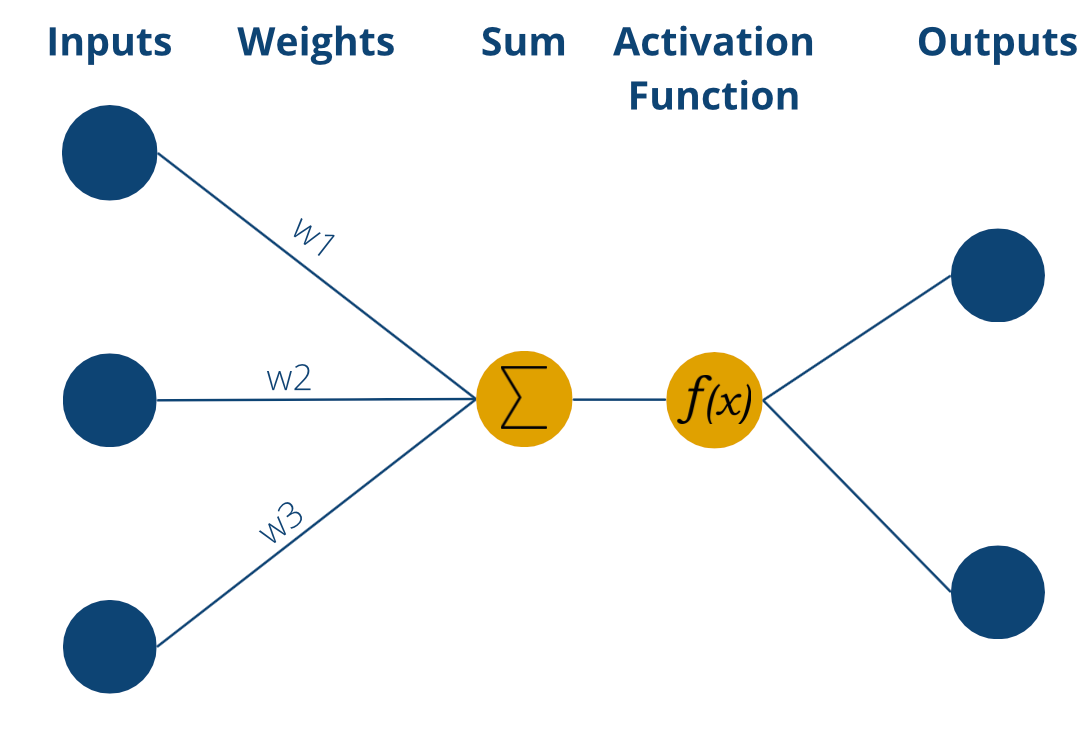

Neural Network with hidden layer(s)

$$\begin{aligned} h_1 &= \sigma(W_1 x + b_1) \\ \hat{y} &= \sigma(W_2 h_1 + b_2) \end{aligned}$$

이 경우 입력 $x$ 는 $h_1$로 변형됨

이 변형에는 비선형 함수 $\sigma$ (또는 ReLU 등)가 포함

즉, 입력 자체가 비선형적으로 표현된 것

신경망은 hidden layer에서 입력을 반복적으로 비선형 함수로 변형하므로,

전체적으로는 비선형 함수를 학습하는 구조가 됩니다.

핵심 포인트 다시 정리하면:

| 항목 | Logistic Regression | Neural Network (with hidden layers) |

| 구조 | $\sigma(w^T x + b)$ | 여러 층에서 $\phi(Wx + b)$ 반복 |

| 비선형 함수 위치 | 출력층에만 | 모든 hidden layer마다 |

| 입력 변형 | 선형만 | 비선형 변형 반복 |

| 결정 경계 | 선형 | 비선형 가능 |

| 모델 분류 | 선형 모델 | 비선형 모델 |

✔️ Logistic regression은 출력에서만 비선형(sigmoid) 을 쓰므로 선형 모델이다.

✔️ Neural Network는 hidden layer마다 비선형 함수를 써서 입력을 반복적으로 변형하므로, 비선형 모델로 분류된다.

'AI & Data Analysis > Deep Learning' 카테고리의 다른 글

| [cellxgene] Data Download (0) | 2025.05.30 |

|---|---|

| [F1 score] Macre vs. Micro vs. Weighted (0) | 2025.05.28 |

| likelihood function vs. probability function (0) | 2025.04.22 |

| [Gini Index] Class Probability Graph (0) | 2025.04.21 |

| [Asymmetric Attributes] Concepts (0) | 2025.04.18 |